Published on:

تتبع صعود الذكاء الاصطناعي: من فضول البشر لحد الثورة الإدراكية

“بصفتي صحفية، طول عمري كان عندي فضول عميق تجاه العالم.” بالكلمات دي، بتفتتح الشخصية الإعلامية الصينية يانغ لان الفيلم الوثائقي Exploring Artificial Intelligence، وبترسم رحلة مدفوعة بأسئلة بتحدد عصرنا بشكل متزايد: هل الآلات بقت أذكى من البشر؟ وهل الذكاء الاصطناعي هيحل محلنا في يوم من الأيام؟ ولأي مدى تقدر التكنولوجيا توسع حدود الذكاء البشري؟

الأسئلة دي اكتسبت إلحاح عالمي في سنة 2016، وهي السنة اللي بتعتبر على نطاق واسع لحظة انطلاق الذكاء الاصطناعي. من البيانات الضخمة والحوسبة السحابية للتعلم العميق والأنظمة المستقلة، انتقل الذكاء الاصطناعي بسرعة من المختبرات لوعي الجمهور.

من الأحداث الفارقة كانت المباراة التاريخية اللي هزم فيها AlphaGo بطل العالم لي سيدول، واللي كانت رمز لتحول في كيفية إدراك البشر لذكاء الآلة.

اللغة، والإدراك، وعقل الآلة

الذكاء البشري اتطور من خلال اللغة. من حوالي 70,000 سنة، تطور أنظمة الكلام المعقدة سمح للبشر بوصف بيئتهم، وتبادل الأفكار المجردة، وبناء المجتمعات. "الثورة الإدراكية" دي أعادت تشكيل الحضارة بشكل جذري.

الفيلم الوثائقي بيطرح سؤال موازي: إزاي الآلات بتفهم اللغة؟

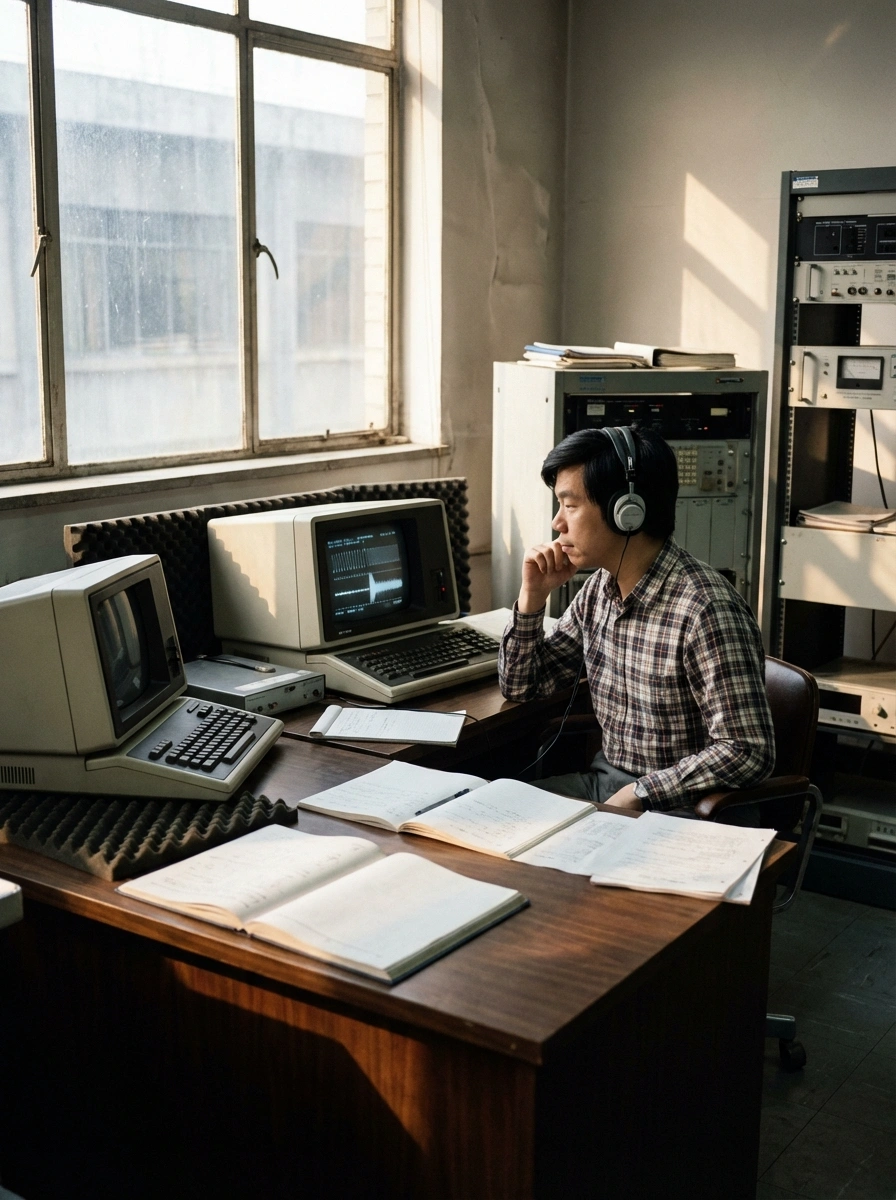

المحاولات الأولى كانت متواضعة. في سنة 1952، علماء في مختبرات بيل (Bell Labs) علموا الآلات التعرف على عشرة أرقام إنجليزية منطوقة، وسموا النظام "Audrey". ومع إنه كان إنجاز وقتها، لكنه فضل بعيد عن الفهم الحقيقي للغة الطبيعية. التقدم كان تدريجي وغالباً محكوم ببيانات وقدرة حوسبة محدودة.

التقدم كان تدريجي وغالباً محكوم ببيانات وقدرة حوسبة محدودة.

نقطة تحول رئيسية حصلت في الثمانينات، لما بدأ كاي فو لي أبحاث التعرف على الكلام في جامعة كارنيجي ميلون. شغله قدم أنظمة قادرة على فهم الكلام المسترسل من متحدثين متعددين—وهي خطوة أساسية نحو التفاعل الطبيعي بين الإنسان والكمبيوتر. ولأول مرة، قدرت الآلات تعالج اللغة المنطوقة بطريقة تشبه الحوار الحقيقي مش مجرد أوامر معزولة.

من الأنظمة القائمة على القواعد للتعلم العميق

بالرغم من التطورات دي، أنظمة الكلام واللغة عانت لعقود. الانفراجة حصلت في منتصف العقد الأول من القرن الحادي والعشرين، مدفوعة بنموذج جديد: التعلم العميق.

في سنة 2006، نشر جيفري هينتون بحث مؤثر عن الشبكات العصبية العميقة، مستوحى من هيكل دماغ الإنسان. ركز شغله على الحجم—نماذج أكبر، طبقات أكتر، وبيانات أكتر بكتير. النهج ده لقى صدى عند باحثين زي دينغ لي، اللي أثبت إنه لما يتم دمج البيانات الضخمة مع قدرة الحوسبة الحديثة، معدلات الخطأ في التعرف على الكلام بتقل بشكل كبير، وأحياناً بنسبة أكتر من 20 في المية في التجارب الأولى.

اللي كان بيعطل الشبكات العصبية في التسعينات مكنش نظرية غلط، لكن نقص البيانات وموارد الحوسبة. ومع توليد الإنترنت لبيانات ضخمة وزيادة قدرة المعالجة، ازدهر التعلم العميق فجأة. المشاكل اللي كانت بتبان مستحيلة الحل بدأت تختفي.

الآلات بتدخل العالم المادي

الفيلم الوثائقي كمان بيستكشف إزاي الذكاء الاصطناعي بيتحرك لما بعد البرمجيات للبيئة المادية. في مختبر الذكاء الاصطناعي بجامعة ستانفورد، الروبوت الشبيه بالبشر PR2 بيقوم بمهام زي التنقل في الممرات، واستخدام الأسانسير، وشراء القهوة للباحثين.

تصميمه مش الهدف منه تقليد البشر، لكن التفاعل بكفاءة مع عالم متمحور حول الإنسان—من خلال الرؤية، والقبض، وتطبيق قوة متحكم فيها.

ده بيعكس تحول أوسع في الروبوتات: الآلات مابقتش محصورة في المصانع. هي دلوقتي بتتعلم التعايش مع الناس، والتكيف مع البيئات المعقدة وغير المنظمة.