Published on:

Apple présente un aperçu de la prochaine génération de Persona pour le Vision Pro et de l'architecture de la puce M5 lors d'une rare discussion technique

Apple a offert un aperçu exceptionnellement détaillé de l'avenir du Vision Pro, révélant des mises à jour majeures de son système Persona, le rôle de la future puce M5, et l'orientation plus large de l'entreprise en matière d'informatique spatiale et d'IA sur l'appareil.

Ces informations proviennent d'un échange technique rare entre les médias et deux dirigeants clés de l'équipe Vision Pro, offrant une image plus claire de la manière dont Apple fait évoluer le Vision Pro vers une plateforme d'informatique spatiale à long terme.

Persona franchit une étape majeure avec le 3D Gaussian Splatting

Suite à la sortie de visionOS 2.0, les utilisateurs ont remarqué une amélioration significative du réalisme de Persona. Au cœur de cette mise à niveau se trouve une technique de rendu relativement nouvelle connue sous le nom de 3D Gaussian Splatting (3DGS).

Contrairement aux graphismes informatiques traditionnels qui reposent sur des maillages construits manuellement, le 3DGS fonctionne en apprenant la géométrie directement à partir d'images capturées. Le système enregistre des vidéos sous plusieurs angles et déduit la structure d'un visage comme une collection d'éléments gaussiens volumétriques — des points en forme d'ellipsoïde avec une position, une échelle et une transparence.

Apple a confirmé que Persona utilise désormais une approche purement basée sur les gaussiennes, sans géométrie de maillage hybride, permettant des transitions de couleurs et des détails de surface très naturels que les maillages peinent à reproduire.

Des avatars FaceTime à l'identité numérique

La vision à long terme d'Apple pour Persona s'étend au-delà des simples appels vidéo. Persona est développé comme une représentation numérique de l'identité, intégrée directement dans des environnements tridimensionnels.

L'entreprise a également mis en avant HUGS (Human Gaussian Splatting), un projet open-source qui étend la technique aux avatars complets. Ces représentations peuvent être articulées avec une animation squelettique, permettant une téléprésence immersive où les participants apparaissent comme des avatars spatiaux en taille réelle au sein des environnements réels des uns et des autres.

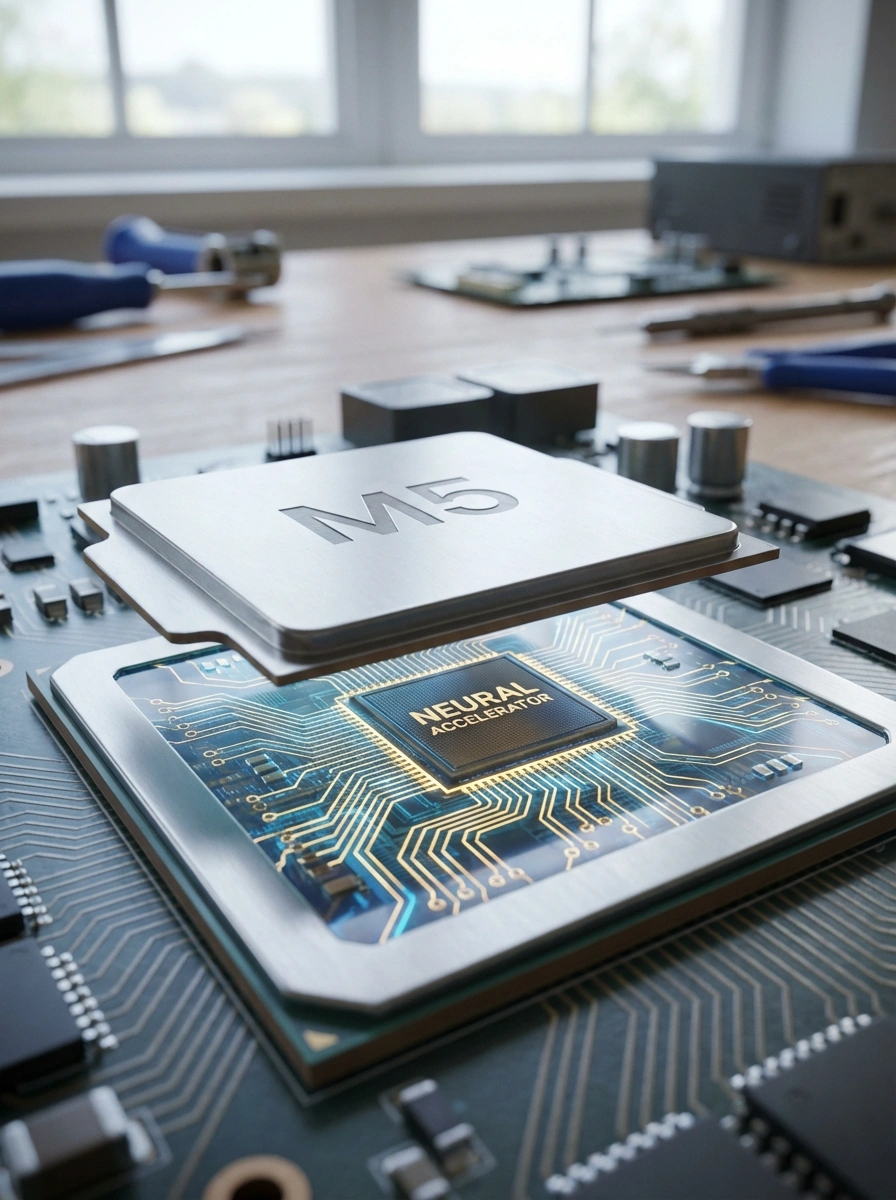

Puce M5 : Une nouvelle architecture GPU conçue pour l'IA et le graphisme

La puce M5 offre ses gains les plus significatifs grâce à des changements architecturaux plutôt qu'à une simple mise à l'échelle brute. Pour la première fois, chaque cœur de GPU inclut un accélérateur neuronal dédié.

Ces accélérateurs au niveau du GPU sont conçus spécifiquement pour les charges de travail de fusion IA-graphisme, telles que :

- Le débruitage par IA

- La super-résolution vidéo

- La génération d'images

- Les effets de rendu avancés

Auparavant, les données devaient se déplacer de manière répétée entre le GPU et le NPU. Avec la puce M5, ces opérations peuvent être effectuées entièrement au sein du GPU, réduisant la latence et améliorant l'efficacité pour les tâches spatiales en temps réel.

Pourquoi le Vision Pro bénéficie le plus de la puce M5

Alors que les gains sur les ordinateurs portables standards peuvent être subtils, le Vision Pro est le principal bénéficiaire de l'architecture M5. En tant que casque à vision directe par vidéo (VST), il exécute en continu des tâches gourmandes en IA, notamment :

- Le SLAM (Simultaneous Localization and Mapping)

- La compréhension de l'environnement

- Le débruitage du passthrough basé sur l'IA

- Le rendu Persona

Presque toutes ces charges de travail s'alignent précisément avec la conception du GPU optimisé pour l'IA de la puce M5, garantissant une expérience spatiale fluide et de haute fidélité.

La philosophie plus large d'Apple en matière d'IA

Apple a réitéré que sa stratégie se concentre sur une intelligence centrée sur l'appareil — construisant des modèles de monde personnels et persistants qui combinent l'entrée visuelle, les données de mouvement et la compréhension spatiale.

Des projets tels que FastVLM, un modèle vision-langage open-source, illustrent cette direction, offrant une inférence rapide et à faible consommation pour une intelligence en temps réel et consciente du contexte. Cela forme une boucle fermée : le monde réel est vectorisé, interprété par l'IA, et reprojeté dans des expériences spatiales immersives.

Technologie, perception et futur

La feuille de route du Vision Pro d'Apple suggère une ambition plus profonde : remodeler la manière dont les humains perçoivent et interagissent avec la réalité grâce à l'informatique. En combinant l'IA spatiale, une incarnation numérique réaliste et un silicium conçu à cet effet, Apple positionne le Vision Pro comme plus qu'un simple casque — c'est une expérience sur la façon dont les systèmes numériques peuvent augmenter la perception humaine elle-même.