Published on:

Tracciare l'ascesa dell'intelligenza artificiale: dalla curiosità umana a una rivoluzione cognitiva

“Come giornalista, sono sempre stata profondamente curiosa del mondo.” Con queste parole, la figura dei media cinesi Yang Lan apre il documentario Exploring Artificial Intelligence, inquadrando un viaggio guidato da domande che definiscono sempre più la nostra era: le macchine stanno diventando più intelligenti degli esseri umani? L'intelligenza artificiale un giorno ci sostituirà? E quanto lontano può spingersi la tecnologia oltre i confini dell'intelligenza umana?

Queste domande hanno acquisito un'urgenza globale nel 2016, un anno ampiamente considerato come il momento della svolta per l'intelligenza artificiale. Dai big data e il cloud computing al deep learning e ai sistemi autonomi, l'IA è passata rapidamente dai laboratori alla coscienza pubblica.

Un evento determinante è stato lo storico match in cui AlphaGo ha sconfitto il campione del mondo Lee Sedol, simboleggiando un cambiamento nel modo in cui gli esseri umani percepiscono l'intelligenza delle macchine.

Linguaggio, cognizione e la mente delle macchine

L'intelligenza umana si è evoluta attraverso il linguaggio. Circa 70.000 anni fa, lo sviluppo di complessi sistemi vocali ha permesso agli esseri umani di descrivere il proprio ambiente, scambiare idee astratte e costruire società. Questa “rivoluzione cognitiva” ha rimodellato fondamentalmente la civiltà.

Il documentario pone una domanda parallela: come fanno le macchine a comprendere il linguaggio?

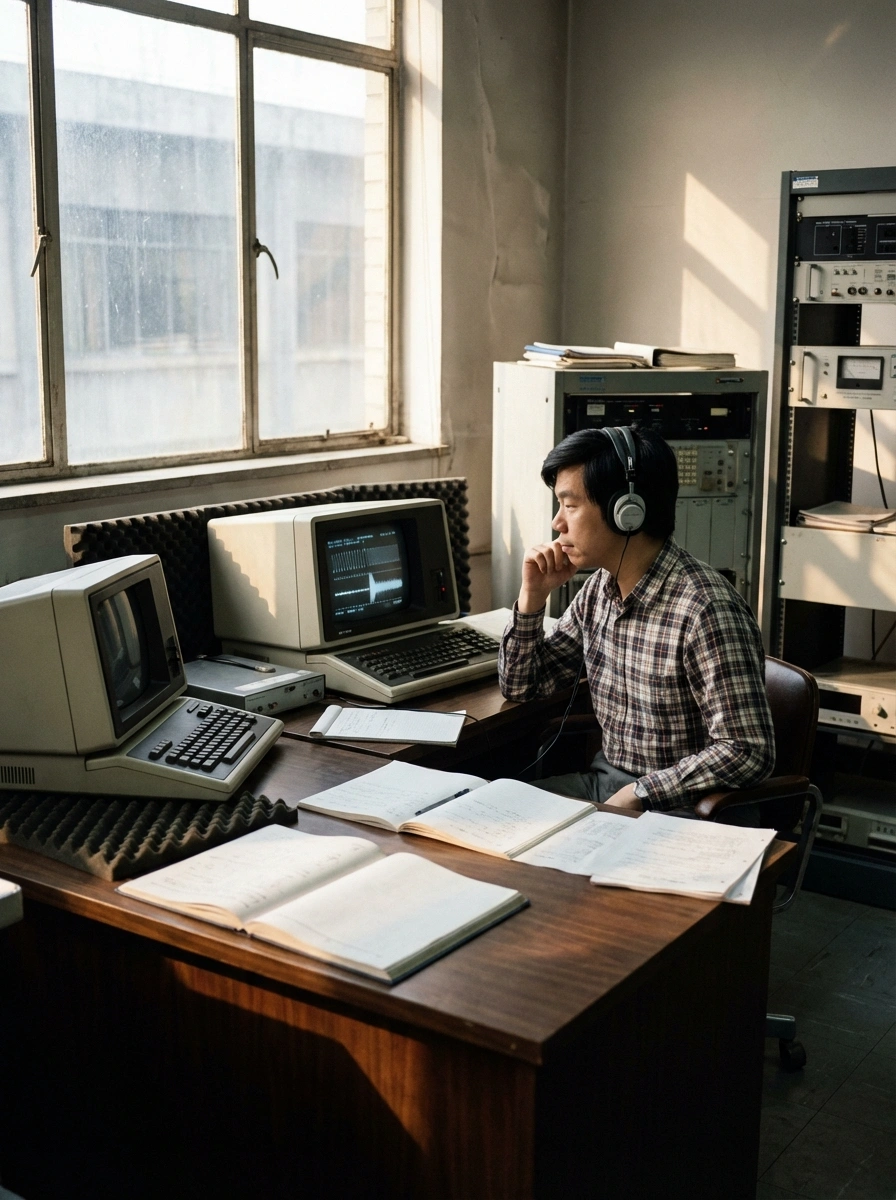

I primi tentativi furono modesti. Nel 1952, gli scienziati dei Bell Labs insegnarono alle macchine a riconoscere dieci cifre parlate in inglese, chiamando il sistema “Audrey”. Sebbene rivoluzionario, era ancora lontano dalla vera comprensione del linguaggio naturale. Il progresso è stato incrementale e spesso limitato da dati e potenza di calcolo ristretti.

Il progresso è stato incrementale e spesso limitato da dati e potenza di calcolo ristretti.

Un punto di svolta importante è arrivato negli anni '80, quando Kai-Fu Lee ha iniziato la ricerca sul riconoscimento vocale alla Carnegie Mellon University. Il suo lavoro ha introdotto sistemi in grado di comprendere il parlato continuo di più interlocutori—un passo essenziale verso l'interazione naturale uomo-computer. Per la prima volta, le macchine potevano elaborare il linguaggio parlato in un modo che somigliava a un vero dialogo piuttosto che a comandi isolati.

Dai sistemi basati su regole al Deep Learning

Nonostante questi progressi, i sistemi di riconoscimento vocale e linguistico hanno faticato per decenni. La svolta è arrivata a metà degli anni 2000, guidata da un nuovo paradigma: il deep learning.

Nel 2006, Geoffrey Hinton ha pubblicato una ricerca influente sulle reti neurali profonde, traendo ispirazione dalla struttura del cervello umano. Il suo lavoro enfatizzava la scala—modelli più grandi, più strati e molti più dati. Questo approccio ha trovato risonanza tra ricercatori come Deng Li, che ha dimostrato che se abbinati a grandi set di dati e alla moderna potenza di calcolo, i tassi di errore nel riconoscimento vocale potevano scendere drasticamente, a volte di oltre il 20 percento nei primi esperimenti.

Ciò che aveva frenato le reti neurali negli anni '90 non era una teoria errata, ma l'insufficienza di dati e risorse computazionali. Con la generazione di enormi set di dati da parte di Internet e l'aumento della potenza di elaborazione, il deep learning è improvvisamente fiorito. Problemi che un tempo sembravano irrisolvibili hanno iniziato a scomparire.

Le macchine entrano nel mondo fisico

Il documentario esplora anche come l'intelligenza artificiale si muova oltre il software verso l'ambiente fisico. Presso il laboratorio di IA della Stanford University, il robot simile a un umanoide PR2 esegue compiti come navigare nei corridoi, usare gli ascensori e acquistare caffè per i ricercatori.

Il suo design non è destinato a imitare gli esseri umani, ma a interagire in modo efficiente con un mondo incentrato sull'uomo—vedendo, afferrando e applicando una forza controllata.

Questo riflette un cambiamento più ampio nella robotica: le macchine non sono più confinate nelle fabbriche. Stanno imparando a coesistere con le persone, adattandosi ad ambienti complessi e non strutturati.